Índice:

- O que é memória NAND?

- A evolução das células: de SLC para PLC

- A arquitetura 2D NAND versus 3D NAND

- O que são ciclos P/E e o desgaste da memória?

- Como a controladora gerencia a vida útil do SSD?

- TRIM e Garbage Collection: a limpeza dos dados

- O papel do cache SLC e da memória DRAM

- Fatores que afetam a retenção e a confiabilidade

- Qual tipo de NAND escolher para cada aplicação?

- A memória flash é segura para backups importantes?

- Por que um sistema de armazenamento em disco é a resposta para a proteção?

Muitos usuários e até alguns profissionais de TI confiam cegamente em SSDs, pendrives e cartões de memória para guardar dados importantes. Essa tecnologia, presente em quase todos os dispositivos modernos, oferece velocidade e praticidade incomparáveis com os antigos discos rígidos. No entanto, poucas pessoas realmente compreendem como ela funciona e quais são suas limitações intrínsecas.

A memória flash não é eterna e está sujeita a um processo de desgaste a cada escrita. Essa degradação silenciosa pode levar à perda de dados sem qualquer aviso prévio, especialmente em dispositivos de baixo custo ou quando submetidos a um uso intenso. A falta de redundância nesses componentes também agrava o problema.

Assim, entender a base do armazenamento flash é fundamental para tomar decisões mais seguras. Conhecer seus mecanismos internos, os riscos associados e as melhores práticas de uso evita surpresas desagradáveis e garante a integridade das informações mais valiosas.

O que é memória NAND?

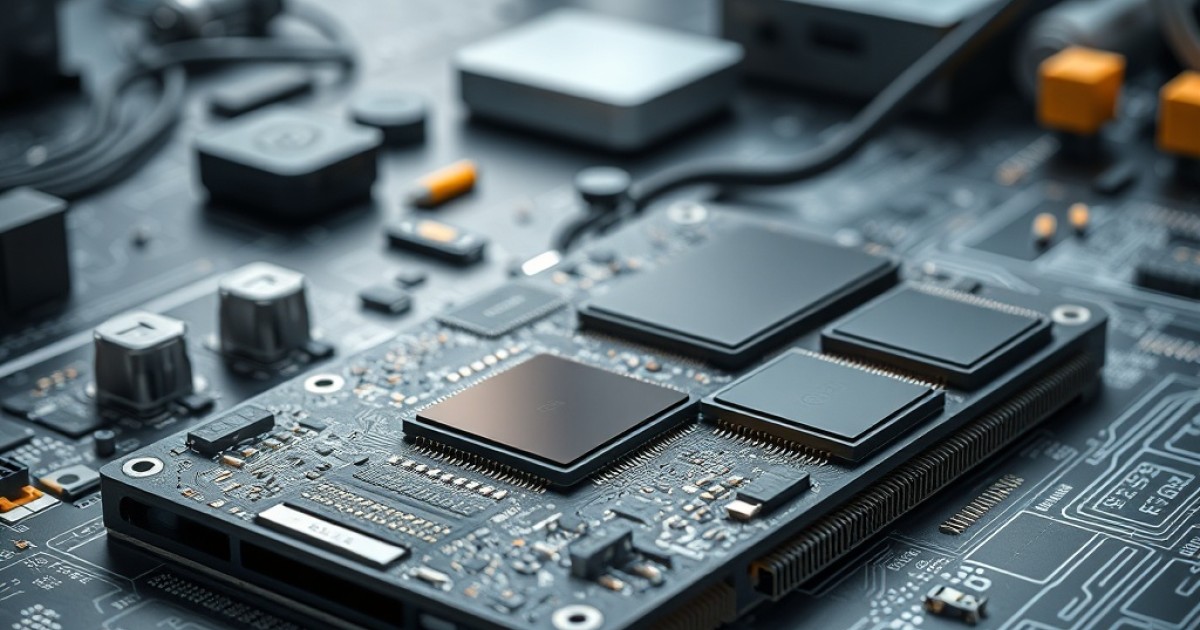

NAND é um tipo de armazenamento não volátil que retém dados mesmo sem energia elétrica. Ela funciona com base em transistores de porta flutuante, que são células capazes de aprisionar ou liberar elétrons para representar os bits 0 e 1. Quase todos os SSDs, smartphones, cartões SD e pendrives utilizam essa tecnologia para armazenar o sistema operacional, aplicativos e arquivos pessoais.

Diferente da memória NOR, que permite acesso aleatório a cada byte e é mais rápida para leitura, a NAND lê e escreve dados em blocos de páginas, o que a torna mais lenta para leitura aleatória, mas muito mais rápida para operações sequenciais e com um custo por gigabyte consideravelmente menor. Essa característica a tornou a escolha ideal para o armazenamento massivo de dados.

A sua arquitetura também simplifica a fabricação e aumenta a densidade do armazenamento. Por isso, a indústria adotou a memória NAND como padrão para substituir os discos rígidos mecânicos em muitas aplicações que exigem velocidade e baixo consumo energético.

A evolução das células: de SLC para PLC

Originalmente, cada célula da memória NAND armazenava apenas um bit de informação, uma tecnologia conhecida como SLC (Single-Level Cell). Os dispositivos SLC eram extremamente rápidos, duráveis e confiáveis, pois a distinção entre os dois estados de carga (0 ou 1) era muito clara. No entanto, seu custo por gigabyte era bastante elevado, limitando seu uso a aplicações empresariais críticas.

Para baratear o armazenamento, os fabricantes desenvolveram novas tecnologias. A MLC (Multi-Level Cell) passou a guardar dois bits por célula, a TLC (Triple-Level Cell) armazena três, a QLC (Quad-Level Cell) quatro, e a mais recente, PLC (Penta-Level Cell), consegue armazenar cinco bits. Cada avanço dobrou a densidade de dados, o que reduziu drasticamente o preço dos SSDs.

Essa evolução, porém, trouxe alguns compromissos. Armazenar mais bits na mesma célula exige um controle de voltagem muito mais preciso e aumenta a probabilidade de erros. Como resultado, a durabilidade (medida em ciclos de escrita) e o desempenho caem a cada nova geração, um trade-off que os fabricantes gerenciam com controladoras cada vez mais sofisticadas.

A arquitetura 2D NAND versus 3D NAND

Durante muitos anos, a indústria aumentou a capacidade dos chips de memória flash ao diminuir o tamanho dos transistores, um processo chamado litografia. Essa abordagem, conhecida como 2D NAND ou planar, funcionou bem por um tempo. Contudo, quando os componentes se tornaram pequenos demais, surgiram problemas de interferência elétrica entre as células vizinhas, o que comprometia a confiabilidade dos dados.

A solução para esse impasse foi a 3D NAND. Em vez de tentar espremer mais células em um plano bidimensional, os engenheiros começaram a empilhá-las verticalmente, como andares em um prédio. Essa inovação permitiu um salto gigantesco na densidade de armazenamento sem a necessidade de encolher ainda mais a litografia, contornando os problemas de interferência.

Atualmente, quase todos os SSDs modernos usam 3D NAND, com centenas ou milhares de camadas. Essa arquitetura não só aumentou a capacidade, mas também melhorou a resistência e a eficiência energética, pois as células podem ser maiores e mais espaçadas, o que reduz o estresse durante as operações de escrita.

O que são ciclos P/E e o desgaste da memória?

Cada operação de escrita ou apagamento em uma célula de memória NAND, conhecida como ciclo de programa/apagamento (P/E), causa um pequeno dano físico à camada de óxido que aprisiona os elétrões. Com o tempo, esse desgaste se acumula e a célula perde sua capacidade de reter uma carga elétrica de forma confiável. Esse fenômeno é a principal causa da degradação e do fim da vida útil de um SSD.

A quantidade de ciclos P/E que uma célula suporta varia drasticamente com a tecnologia. Uma célula SLC pode suportar cerca de 100.000 ciclos, enquanto uma MLC aguenta em torno de 3.000 a 10.000. Já as células TLC e QLC, comuns em SSDs de consumo, geralmente têm uma durabilidade entre 300 e 3.000 ciclos.

Embora esses números pareçam baixos, as controladoras dos SSDs modernos usam várias técnicas para mitigar esse desgaste. Por isso, mesmo um SSD TLC ou QLC pode durar muitos anos em um uso doméstico ou de escritório típico. O problema surge em cenários de escrita intensa, como servidores ou workstations, onde o limite de ciclos pode ser atingido mais rapidamente.

Como a controladora gerencia a vida útil do SSD?

A controladora é o cérebro do SSD e desempenha um papel vital para maximizar sua durabilidade e desempenho. Uma de suas principais funções é o wear leveling (nivelamento de desgaste), um algoritmo que distribui as operações de escrita uniformemente por todas as células de memória. Isso evita que alguns blocos sejam usados excessivamente enquanto outros permanecem ociosos, prolongando a vida útil do conjunto.

Outra técnica importante é o over-provisioning. Os fabricantes reservam uma parte da capacidade total da NAND (geralmente de 7% a 28%) para uso exclusivo da controladora. Esse espaço extra serve como uma área de trabalho para gerenciar blocos defeituosos, realizar a coleta de lixo e substituir células gastas, o que mantém o desempenho estável ao longo do tempo.

Além disso, a controladora implementa o ECC (Error Correction Code), um mecanismo que detecta e corrige erros de bits que ocorrem naturalmente durante a leitura dos dados. Conforme as células envelhecem, a taxa de erros aumenta, mas algoritmos avançados de ECC conseguem compensar essa degradação e garantir a integridade dos arquivos por muito mais tempo.

TRIM e Garbage Collection: a limpeza dos dados

Em um disco rígido, apagar um arquivo simplesmente marca o espaço como disponível na tabela de alocação de arquivos, e os novos dados podem ser gravados diretamente por cima. Na memória NAND, o processo é mais complexo. Antes de escrever em uma página, todo o bloco que a contém precisa ser apagado. Essa limitação frequentemente causa uma queda de desempenho com o tempo.

Para resolver isso, foi criado o comando TRIM. Quando você apaga um arquivo em um volume de armazenamento, ele envia um comando TRIM ao SSD, informando quais páginas não contêm mais dados válidos. A controladora então pode apagar esses blocos proativamente durante os períodos de inatividade, em vez de esperar pelo momento da escrita.

Esse processo de limpeza interna é chamado de Garbage Collection (coleta de lixo). A controladora identifica os blocos com páginas marcadas como inválidas pelo TRIM, copia os dados ainda válidos para um novo bloco e apaga o antigo, deixando-o pronto para futuras gravações. Essas duas tecnologias trabalham juntas para manter a velocidade de escrita do SSD sempre alta.

O papel do cache SLC e da memória DRAM

As memórias TLC e QLC são mais baratas e densas, mas sua velocidade de escrita nativa é relativamente baixa. Para mascarar essa lentidão e oferecer uma experiência de uso mais fluida, muitos SSDs de consumo utilizam uma pequena porção da NAND configurada para operar em modo SLC. Esse cache SLC dinâmico recebe os dados em alta velocidade e, posteriormente, os transfere para a área TLC/QLC principal quando o drive está ocioso.

Essa abordagem funciona muito bem para tarefas cotidianas, que geralmente envolvem a escrita de pequenos volumes de dados. O problema ocorre durante a transferência de arquivos muito grandes. Quando o cache SLC se esgota, a velocidade de escrita do SSD cai drasticamente para sua taxa nativa, um comportamento que frequentemente surpreende os usuários.

SSDs de maior desempenho também incluem um chip de memória DRAM separado. Esse componente armazena o mapa de endereçamento dos dados, o que acelera muito o acesso aos arquivos. Modelos mais baratos, conhecidos como "DRAM-less", usam uma pequena parte da memória RAM do próprio computador para essa tarefa, uma solução que economiza custos mas impacta negativamente o desempenho em multitarefa.

Fatores que afetam a retenção e a confiabilidade

A retenção de dados é a capacidade da célula de memória de manter a informação armazenada por um longo período sem energia. Vários fatores influenciam essa capacidade. A temperatura é um dos principais vilões. Altas temperaturas aceleram a perda de elétrons das células, o que pode levar à corrupção de dados em dispositivos guardados em locais quentes ou mal ventilados.

Outro fenômeno curioso é o "read disturb". A leitura de uma página em um bloco pode causar um leve estresse elétrico nas células vizinhas. Se a mesma área for lida repetidamente milhares de vezes sem nenhuma escrita intermediária, essa perturbação pode, em casos raros, alterar o estado das células adjacentes. As controladoras modernas, no entanto, monitoram isso e atualizam os blocos periodicamente para evitar o problema.

Com o tempo, algumas células inevitavelmente falham e se tornam "bad blocks". A controladora do SSD detecta esses blocos defeituosos e os marca como inutilizáveis, realocando seus dados para a área de over-provisioning. A presença de alguns bad blocks é normal, mas um aumento rápido em seu número geralmente indica que o drive está se aproximando do fim de sua vida útil.

Qual tipo de NAND escolher para cada aplicação?

A escolha da memória flash correta depende inteiramente do seu caso de uso. Para servidores de banco de dados, de cache ou qualquer aplicação com escrita intensa e contínua, os SSDs com NAND SLC ou MLC são os mais indicados. Sua alta durabilidade e desempenho consistente justificam o investimento, ainda que sejam bem mais caros.

Para computadores de trabalho, estações de jogos e uso geral, os SSDs com NAND TLC são o ponto de equilíbrio ideal. Eles oferecem um ótimo desempenho para as tarefas do dia a dia, uma durabilidade mais que suficiente para a maioria dos usuários e um preço bastante acessível. A grande maioria dos SSDs NVMe e SATA vendidos hoje utiliza essa tecnologia.

Já os SSDs com NAND QLC são projetados para aplicações com foco em leitura, como armazenamento de jogos, bibliotecas de mídia ou como um substituto mais rápido para discos rígidos. Eles oferecem as maiores capacidades com o menor custo por gigabyte. No entanto, sua baixa durabilidade e o desempenho de escrita inconsistente os tornam inadequados para cargas de trabalho pesadas.

A memória flash é segura para backups importantes?

Apesar de toda a sua tecnologia e velocidade, um SSD, pendrive ou cartão de memória, por si só, raramente é a melhor opção para um backup seguro e de longo prazo. O principal motivo é a ausência de redundância. Se a controladora falhar, se ocorrer um dano elétrico ou se o desgaste das células atingir um nível crítico, todos os dados podem ser perdidos instantaneamente, sem chance de recuperação.

A retenção de dados em longo prazo também é uma preocupação. Um SSD desconectado da energia por muitos meses ou anos pode começar a perder dados, especialmente se já estiver bastante desgastado ou se for armazenado em um local com temperatura elevada. A memória flash precisa de energia periodicamente para que a controladora possa realizar as rotinas de manutenção interna.

Além disso, esses dispositivos estão diretamente conectados ao computador de produção. Isso os torna vulneráveis a ataques de ransomware, exclusão acidental de arquivos e falhas do hardware de armazenamento. Um backup verdadeiramente seguro precisa estar isolado do ambiente principal e, preferencialmente, contar com algum tipo de proteção contra falhas de hardware.

Por que um sistema de armazenamento em disco é a resposta para a proteção?

Um servidor de armazenamento populado por hard disks resolve as principais fragilidades do armazenamento em memória flash. Esses equipamentos utilizam múltiplos discos, geralmente configurados em RAID (Redundant Array of Independent Disks), para criar redundância. Se um dos discos falhar, os dados permanecem intactos e acessíveis nos outros, e basta substituir a unidade defeituosa para restaurar a proteção.

Além da tolerância a falhas, um disk storage centraliza os dados em um local seguro na rede, isolado dos computadores individuais. Ele possui seu próprio sistema operacional, com recursos avançados como snapshots, que criam cópias de segurança instantâneas e imutáveis dos arquivos. Em caso de um ataque de ransomware ou exclusão acidental, é possível restaurar uma versão anterior com apenas alguns cliques.

Os servidores de armazenamento em rede também incluem softwares para automatizar aplicações de backup de múltiplos dispositivos, garantem o acesso controlado com permissões de usuário e oferecem a possibilidade de replicação para outro local. Portanto, enquanto um SSD acelera o desempenho do seu computador, um storage redundante é a resposta para garantir que seus dados estejam verdadeiramente protegidos.

Fale Conosco

Fale Conosco